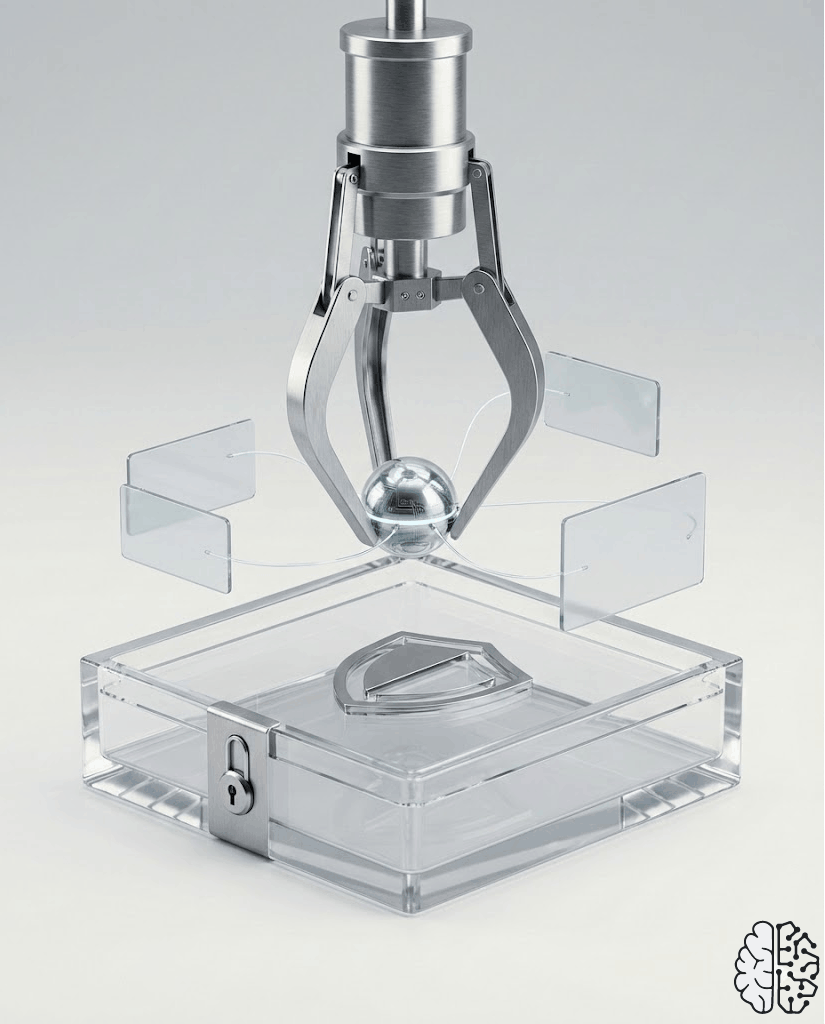

OpenClaw agentes con inteligencia artificial: cómo funcionan, por qué parecen “magia” y cuáles son los riesgos reales

En redes sociales, los OpenClaw agentes con inteligencia artificial se muestran como si fueran un truco: “les hablas por chat y te organizan la vida”. El problema es que esas demos, aunque impresionantes, suelen ocultar lo más importante: estos sistemas no son magia; son software con acceso potencial a herramientas reales (archivos, navegador, comandos, integraciones) y, por tanto, con una superficie de riesgo proporcional a su poder. Este artículo aterriza el tema con claridad: qué es OpenClaw, cómo opera un sistema de agentes, por qué el concepto de skills acelera capacidades (y también riesgos), cómo se combinan distintos modelos de IA para tareas diferentes, y por qué hoy lo más sensato es pensar en despliegues controlados (por ejemplo, en servidores virtuales con acceso limitado) en lugar de conectarlo “a todo tu computador”. Qué es OpenClaw y por qué los OpenClaw agentes con inteligencia artificial están generando tanto ruido OpenClaw es un proyecto de agente/assistant “agentic” que se integra con canales de mensajería y puede ejecutar tareas mediante herramientas y extensiones. El salto frente a un chatbot tradicional es que no solo “responde”: puede actuar, si se le habilitan herramientas y permisos. Esa capacidad de acción (sobre archivos, navegación, automatizaciones y servicios) es lo que lo vuelve atractivo para productividad… y lo que encendió alarmas en seguridad en 2026, cuando comenzaron reportes de abuso del ecosistema de extensiones/skills y exposición de instancias mal configuradas. Cómo funcionan los agentes: no “piensan” como humanos, coordinan decisiones y herramientas Para entender por qué parece magia, hay que ver la mecánica real: En otras palabras: los agentes funcionan como un bucle de decisión + ejecución. El LLM no es “consciente”; es un motor estadístico entrenado con machine learning para predecir el siguiente token y, en escenarios agentic, para seleccionar acciones entre herramientas disponibles. La “autonomía” viene de la orquestación, no de la voluntad. Skills: el acelerador de capacidades… y el talón de Aquiles Una razón clave por la que los OpenClaw agentes con inteligencia artificial escalan tan rápido es el ecosistema de skills: paquetes/extendidos que agregan capacidades (flujos, integraciones, automatizaciones, plantillas de tareas). Lo bueno Lo delicado En 2026 se reportó que cientos de skills maliciosas en el registry/marketplace se usaron para robar credenciales o inducir ejecución de acciones peligrosas (un problema clásico de supply chain). Esto no es un detalle técnico: si un agente tiene permiso para leer archivos o ejecutar acciones, una skill maliciosa puede convertir una “demo de productividad” en un vector de exfiltración. Modelos de IA en un mismo sistema: por qué no existe “un modelo perfecto” para todo Otro punto que confunde en redes: “el agente” no es sinónimo de “un modelo”. En implementaciones modernas, se usan estrategias de múltiples modelos (por ejemplo, un modelo principal y modelos de respaldo) para balancear: La idea de model fallbacks (modelo principal + alternativos) en OpenClaw aparece en guías de integración y documentación del ecosistema: si el principal no está disponible, el sistema intenta con los siguientes. En términos empresariales, esto habilita algo poderoso: agentes especializados. El punto crítico: agentes conectados a archivos, navegador y herramientas amplían la “zona de impacto” La revolución agentic tiene un costo: cuando un agente puede “tocar” el mundo real (archivos, credenciales, navegador), cualquier falla de control se vuelve seria. Los riesgos más relevantes que hoy se discuten para OpenClaw (y sistemas similares) incluyen: 1) Prompt injection Contenido malicioso (por ejemplo, una página web o un correo) puede intentar manipular al agente: “ignora instrucciones”, “ejecuta esto”, “extrae aquello”. La documentación de seguridad enfatiza que los prompts no son una barrera dura; la contención real debe ser por políticas de herramientas, aprobaciones y sandboxing. 2) Skills maliciosas (supply chain) Reportes de auditoría y análisis señalaron campañas con skills contaminadas que entregan infostealers y roban tokens/credenciales. 3) Robo de tokens y configuración por malware “común” Un hallazgo clave: ni siquiera se requiere un malware “especializado”. Investigaciones indicaron que infostealers genéricos ya pueden capturar configuraciones y secretos de setups de agentes. 4) Exposición accidental de instancias Parte de la crisis reciente vino de instancias expuestas o con controles insuficientes, ampliando el riesgo de acceso no autorizado. Por qué todavía es prematuro conectar OpenClaw a “todo tu computador personal” En un computador personal suele vivir “la corona”: Conectar un sistema agentic con herramientas amplias a ese entorno equivale a darle un radio de acción enorme. Y aunque se use “local”, el riesgo no desaparece: basta una skill maliciosa, una mala configuración o un ataque por prompt injection para provocar filtración o acciones no deseadas. Por eso, el enfoque responsable hoy es tratar a los OpenClaw agentes con inteligencia artificial como se trataría a cualquier software con poder: principio de mínimo privilegio, aislamiento y control de superficie. La recomendación madura: entornos aislados y acceso limitado (VPS/VM) antes que “mi laptop personal” Para organizaciones (y para usuarios con información sensible), el camino prudente suele ser: La guía de seguridad de OpenClaw insiste en que la defensa real viene de tool policy, approvals, sandboxing y allowlists, no de “poner un prompt fuerte”. Aterrizando la promesa: qué sí es realista esperar en 2026 Lo realista (y valioso) hoy: Lo que no es realista verlo como “magia segura”: En 2026, el mercado se está moviendo rápido, pero también está aprendiendo a golpes: la productividad agentic avanza, y la seguridad está corriendo para alcanzarla. CTAs EM2C Si tu empresa está evaluando agentes de IA (como OpenClaw) para productividad, operaciones o automatización, lo sensato es empezar por una arquitectura segura: alcance, datos permitidos, controles, y modelo de gobernanza.